این فناوری میتواند سرنوشت همه چیز را تغییر دهد!

دیپ فیک (Deep Fake) فناوری جدیدی بر مبنای هوش مصنوعی است که بهواسطه آن تصاویر و ویدیوهای دروغین اما واقع گرایانه درست میشود و میتواند هر بینندهای را تحت تاثیر خود قرار دهد.

برترینها: فناوری دیپ فیک چیست؟ چرا استفاده از نرم افزار دیپ فیک خطرناک است؟ اگر تمایل دارید درباره تکنولوژی جعل عمیق بیشتر بدانید و با چند برنامه دیپ فیک آشنا شوید، در ادامه با ما همراه باشید.

دیپ فیک (Deep Fake) فناوری جدیدی بر مبنای هوش مصنوعی است که بهواسطه آن تصاویر و ویدیوهای دروغین اما واقع گرایانه درست میشود و میتواند هر بینندهای را تحت تاثیر خود قرار دهد.

امروزه ویدیوهای دیپ فیک بسیاری از هنرمندان و افراد مشهور ساخته میشود و بیننده بدون آنکه متوجه عدم صحت و واقعیت آنها شود، محتوای آنها را باور کرده و به انتشار آنها در فضای مجازی دست میزند. در نتیجه با توجه به پیشروی بدون محدودیت این فناوری، باید گفت که به زودی تشخیص بین مرز حقیقت و دروغ کاملا غیرممکن میشود.

دیپ فیک یا فناوری «جعل عمیق» چیست؟

فناوری دیپ فیک (Deep Fake) یا «جعل عمیق» در سال 2014 برای اولین بار توسط یک دانشجوی مقطع دکترا به نام «ایان گودفلو» اختراع شد. گفتنی است گودفلو در حال حاضر در شرکت اپل مشغول به کار است.

دیپ فیک از ترکیب دو واژه دیپ (Deep) به معنای عمیق و فیک (Fake) به معنای جعلی و دروغین تشکیل شده است و براساس هوش مصنوعی قادر است تصاویر انسان را به صورت واقع گرایانه تولید و سنتز کند. در فناوری Deep Fake یا همان جعل عمیق، از دسته خاصی از الگوریتم یادگیری ماشین با نام «شبکههای مولد تخاصمی» یا «Generative Adversarial Networks» استفاده میشود تا تصاویر یا ویدیوهای موجود روی مجموعهای از تصاویر و ویدیوهای منبع، ترکیب و برهمنهی شود.

تکنولوژی جعل عمیق مبتنی بر روش یادگیری عمیق است و از شبکههای مولد تخاصمی که به اختصار به آنها شبکههای GAN گفته میشود، استفاده میکند. الگوریتمهای GAN از دو مدل هوش مصنوعی تشکیل میشوند. در این سیستم وظیفه یکی از مدلها تولید محتوا (تولید تصاویر افراد) و وظیفه مدل رقیب، تشخیص واقعی بودن و یا جعلی بودن عکس تولید شده است. گفتنی است در ابتدای کار مدل هوش مصنوعی رقیب قادر است به راحتی عکس جعلی را از عکس واقعی تشخیص دهد اما با گذشت زمان دقت و عملکرد مدل هوش مصنوعی تولید کننده به قدری افزایش مییابد که تشخیص جعلی بودن محتوای تولید شده برای مدل رقیب بسیار سخت میشود.

چرا فناوری دیپ فیک خطرناک است؟

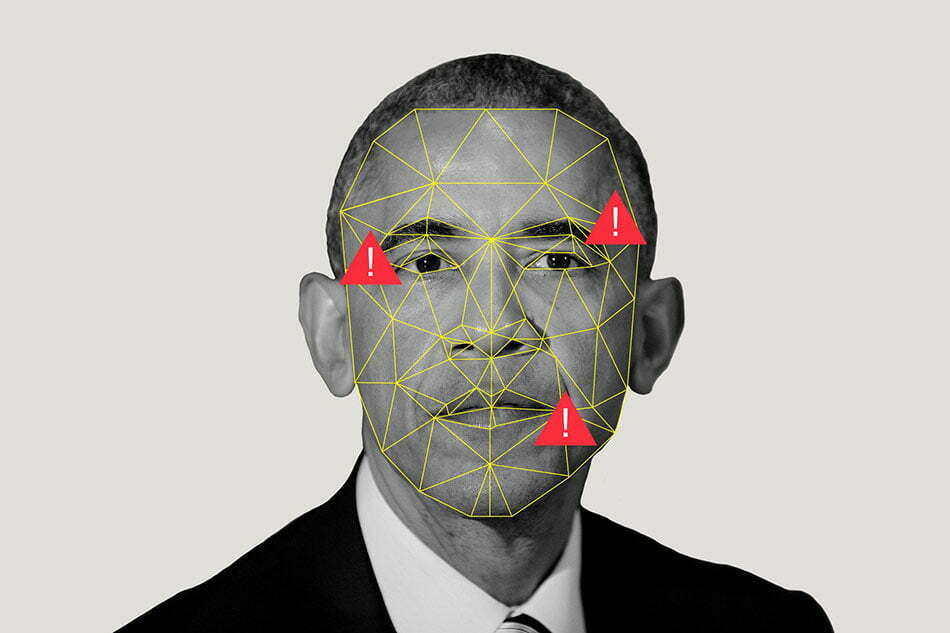

فناوری دیپ فیک یا همان جعل عمیق در طول ظهور و پیدایش خود، نه تنها جامعه بازیگران و سلبریتیها را هدف گرفته بلکه به حریم چهرههای بزرگ سیاستمدار نیز تجاوز کرده است. به عنوان مثال ویدیویی از باراک اوباما منتشر شد که در آن دونالد ترامپ را فردی حقیر و غیرمنطقی خطاب میکرد. اگرچه این ویدیو صحت نداشت و کاملا غیرواقعی بود اما افراد زیادی در ابتدا آن را باورد کردند و دست به انتشار آن در فضای مجازی کردند. در همین راستا رئیس جمهور سابق آمریکا، باراک اوباما، در خصوص تکنولوژی Deep Fake اظهار نظر کرده و ابراز کرده است در دنیایی که میتوانند به سادگی صحبتها و ویدیوهای غیرواقعی از من ساخته و منتشر کنند، به مرحلهای خواهیم رسید که تشخیص مرز بین واقعیت و دروغ بسیار مشکل خواهد شد و این مطمئنا بر پایههای دموکراسی ما که بر مبنای حقیقت است، تاثیر خواهد گذاشت.

در حقیقت از آنجا که این فناوری بر مبنای هوش مصنوعی است و نیازی به دخالت مستقیم انسان ندارد، هر فردی میتواند از طریق Deep Fake، ویدیوی جعلی و در عین حال واقعگرایانه تولید کند. در نتیجه متاسفانه افراد با اهداف خصمانه میتوانند فیلمهای غیراخلاقی از چهرههای مشهور تهیه و تولید کنند و زندگی شخصی آنها را به راحتی به خطر بیندازند. گفتنی است این فناوری سبب کسب درآمد نیز شده است و افراد بسیاری در انجمنهای اینترنتی مختلفی وجود دارند که حاضرند برای ساخت یک ویدیوی دیپ فیک و غیراخلاقی از فرد موردنظرشان پول زیادی پرداخت کنند.

علاوه بر ایجاد محتوای غیراخلاقی از افراد مختلف، Deep Fake میتواند واقعیات جامعه را تحریف کرده و اطلاعات نادرست و غیرواقعی به افراد جامعه ارائه کند. در نتیجه حریم خصوصی افراد به راحتی مورد هدف قرار گرفته و دموکراسی و امنیت ملی یک کشور نیز به خطر میافتد.

نمونه هایی از ویدیوهای Deep Fake

در این قسمت نمونههایی از استفاده از نرم افزار دیپ فیک برای تولید ویدیوهای غیرواقعی از افراد معروف ارائه شده است.

۱- ولودیمیر زلنسکی

سیاستمداران و افراد مشهور از اصلیترین قربانیهای فناوری Deep Fake هستند.

گفتنی است استفاده از چهرههای مشهور برای ساخت ویدیوهای جعلی با استفاده از دیپ فیک از این جهت آسانتر است که عکسها و ویدیوهای کافی از آنها در دسترس است و میتوانند منبع خوبی برای فناوری جعل عمیق باشند؛ اما با توجه به آنکه امروزه عکسهای شخصی بسیاری از افراد مختلف در فضای مجازی بارگذاری میشود، بنابراین احتمالا در آینده نه چندان دور هر فرد معمولی خواهد توانست به عنوان منبع و سوژه این فناوری قرار بگیرد.

در جدیدترین سوء استفاده از این تکنولوژی، ویدیوی «دیپ فیک» روسهاست که ولودیمیر زلنسکی رئیسجمهور اوکراین را به صورت ساختگی نمایش داده و مایه تمسخر کارشناسان حوزه فناوری و کاربران شبکههای اجتماعی شده. در این ویدیو «دیپ فیک» زلنسکی ساختگی از نیروهای اوکراینی میخواهد سلاحهای خود را زمین بگذارند و تسلیم ارتش روسیه شوند. کارشناسان میگویند ساختگی بودن این ویدیو قابل تشخیص است، اما پیشرفت فناوری «دیپ فیک» نگرانکننده است.

۲- باراک اوباما

یک سال قبل از آنکه فیلم زیر منتشر شود، مهندسان کامپیوتر دانشگاه واشنگتن از شبکه عصبی هوش مصنوعی برای مدلسازی فرم دهان باراک اوباما استفاده کردند و آن را با ورودی صوتی همگام ساخته بودند.

در ویدیوی زیر دهان کمدین معروف جردن پله جایگزین دهان باراک اوباما شده و سپس با استفاده از اپلیکیشن FakeApp و در طی مدت زمان بیش از 50 ساعت، این ویدیو با دقت شگفتآوری ساخته شده است.

۳- نانسی پلوسی

ویدیوی بعدی که در ادامه مشاهده خواهید کرد نمونه بارزی است از اینکه استفاده از دیپ فیک در مسائل سیاسی تا چه اندازه میتواند خطرناک باشد. در این ویدیو، نانسی پلوسی سخنگوی مجلس نمایندگان ایالت متحده آمریکا در حال سخنرانی است اما در نسخه جعلی سرعت صحبتهای پلوسی حدود 25 درصد کمتر شده است و جوری به مخاطب وانمود میشود که گویی پلوسی مست است. این ویدیوی جعلی در یکی از پیجهای فیسبوک با نام Politics Watchdog بارگذاری و به سرعت منتشر شد؛ تا جایی که رودی جولیانی شهردار سابق نیویورک در توئیتی نوشت: «چه اتفاقی برای نانسی پلوسی افتاده است؟ سخنرانی او کمی عجیب بود!»

در همین راستا فیسبوک در ابتدا نپذیرفت که ویدیو را به صورت کامل حذف کند؛ اما اظهار کرد پس از آنکه عدم صحت ویدیو ثابت شد، توزیع و انتشار آن را کاهش داده است. جالب اینجا است که این پست پس از مدتی حذف شد اما مشخص نشد که چه کسی پشت ساخت این ویدیوی جعلی بود. همان طور که مشاهده خواهید کرد این ویدیو یک نمونه کوچک از سوء استفاده از فناوری Deep Fake است و نشان میدهد که به چه آسانی میتوان صدای یک ویدیو را همانند یک سند متنی، دستکاری کرد.

۴- مارک زاکربرگ

در پاسخ به امتناع فیسبوک از حذف ویدیوی نانسی پلوسی، بیل پوستر هنرمند معروف در ماه ژوئن در پیج اینستاگرام خود ویدیوی زیر را منتشر کرد. در این ویدیو نشان داده میشود که چگونه مارک زاکربرگ با افتخار از مالکیت فیسبوک و نحوه تاثیر آن بر کاربران سخن میگوید. این ویدیو توسط نرم افزار اسرائیلی Canny AI’s VDR که مربوط به ساخت ویدیو با تکنیک جابهجایی دیالوگ است، ساخته شده بود و نشان میداد که چگونه گفتار ساده هر فرد میتواند مورد دستکاری و تغییر قرار بگیرد.

گفتنی است اینستاگرام این ویدیوی جعلی از مارک زاکربرگ را حذف نکرد؛ اما اعلام کرد که با این ویدیوی جعلی همانند سایر محتواهای نادرست منتشر شده در اینستاگرام رفتار خواهد کرد و چنانچه یک شخص حقیقی عدم صحت این ویدیو را تائید کند، ویدیو را فیلتر خواهد کرد. این در حالی است که بیل پوستر این ویدیو را با هشتگ Deep Fake منتشر کرده بود.

۴ سایت و برنامه دیپ فیک

در این بخش میخواهیم چند سایت و اپلیکیشن Deep Fake را معرفی کنیم که با استفاده از آنها میتوانید چهره خود را روی افراد دیگر قرار دهید.

۱. برنامه دیپ فیک Zao

اپلیکیشن چینی Zao که سال 2019 به عنوان یکی از پرسروصداترین اپها شناخته میشد، قادر است در کسری از ثانیه با دریافت چند عکس از کاربر، چهره او را به سلبریتی موردعلاقهاش تبدیل کند. اما پس از چندی کاربران بسیاری به سرعت موجی از نارضایتی خود را در خصوص نقض حریم خصوصی خود اعلام کردند و حال این برنامه دیپ فیک، سیاستهای خود را بعد از واکنش جدی و بازخوردهایی که از سوی کاربران دریافت کرده، تغییر داده است.

این اپلیکیشن قادر است با استفاده از هوش مصنوعی، تصویر چهره کاربر را روی چهره یک شخص دیگر گذاشته و در قالب یک فایل گیف (GIF) و یا حتی ویدیو آن را به نمایش درآورد. نرم افزار دیپ فیک Zao یک اپلیکیشن رایگان است و به عنوان یکی از پرطرفدارترین برنامههای موجود در اپ استور شناخته میشود. نحوه نصب و استفاده از این برنامه بسیار ساده و آسان است. کافی است پس از نصب، شماره موبایل خود را وارد کرده و سپس تعدادی از عکسهای موجود در گوشی خود را روی برنامه بارگذاری کنید. حال میتوانید ویدیوهای سلبریتیهای مختلف از دی کاپریو گرفته تا مارلین مونرو، یکی را انتخاب کنید تا اپلیکیشن چهره شما را روی تصویر سلبریتی موردعلاقهتان برهمگذاری کند.

در حال حاضر برنامههای متنوعی نظیر Zao موجود هستند که با تکنیک هوش مصنوعی و Deep Fake، چهره کاربر را تغییر میدهند و بیشتر جنبه فان و سرگرمی دارند اما با توجه به گزارشات متعدد در مورد نقض حریم شخصی کاربران، توصیه میشود قبل از استفاده از این نوع اپلیکیشنها، قوانین هر کدام را با دقت مطالعه کنید.

۲. سایت دیپ فیک Deepfakes web β

Deepfakes web β یک سرویس وب است که به شما اجازه میدهد تا ویدیوهای Deep Fake را در اینترنت بسازید. این سایت از یادگیری عمیق برای دریافت پیچیدگیهای مختلف چهره استفاده میکند.

با وجود اینکه این سایت از پردازنده گرافیکی قدرتمند در فضای ابری استفاده میکند، ممکن است ساعتها برای رندر کردن تمامی دادهها زمان نیاز باشد. این سایت نشان میدهد که ساخت ویدیوهای دیپ فیک کار هر کسی نیست و مشاهده انجام این کار در عرض چند ثانیه توسط Zao، واقعا امر متحولکنندهای است. این سایت پولی بوده و هزینه استفاده برای هر ساعت آن، 2 دلار است.

۳. سایت دیپ فیک MachineTube

MachineTube سایت دیگری است که به شما اجازه میدهد تا در کامپیوتر خود، ویدیوهای دیپ فیک بسازید. این سایت مانند Deepfakes web β از پردازش ابری برای خلق ویدیوها استفاده نمیکند و به جای آن، از قدرت پردازشی کامپیوتر شما بهره خواهد بود.

از این امر دو مورد برداشت میشود: اول اینکه نیاز به کامپیوتر قوی با کارت گرافیک خوب با حداقل 2 گیگابایت VRAM دارید و دوم اینکه ساعتها طول خواهید کشید تا به ویدیوی Deep Fake مورد نظر خود دسترسی داشته باشید که وابسته به منابع کامپیوتری خود شما است. MachineTube از الگوریتمهای بسیار پیشرفته یادگیری عمیق خود استفاده میکند تا دادههای تصویری را پردازش کند. شما باید ویدیو و نمونههای تصویری را آپلود کرده و سپس MachineTube کار تغییر چهرهها را آغاز میکند. چندین مدل از پیش تعریف شده هم مانند کانیه، اوباما، راک، کیج و … هم وجود دارند. بهترین چیز درباره این سایت آن است که استفاده از آن کاملا رایگان است.

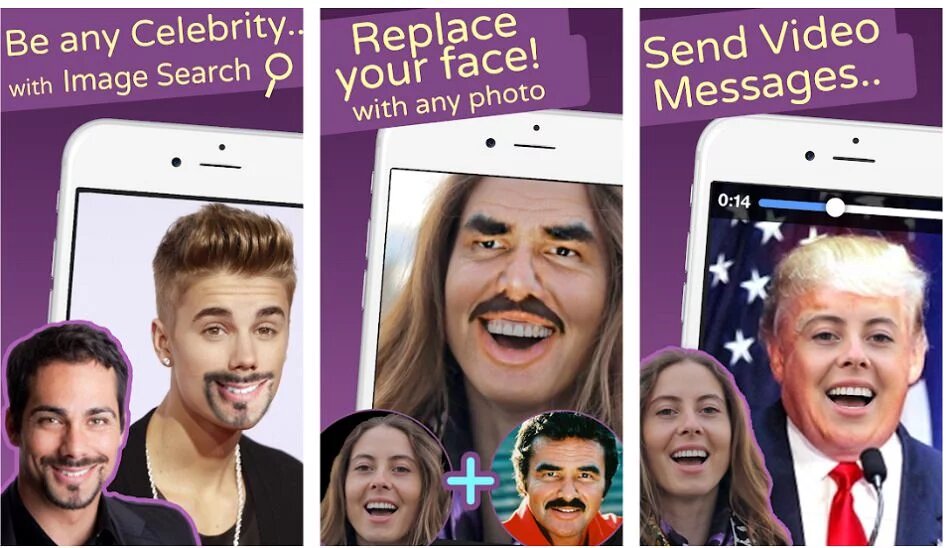

۴. برنامه دیپ فیک Face Swap Live

Face Swap Live را نمیتوان واقعا یک نرم افزار دیپ فیک دانست؛ اما به شما اجازه میدهد تا تصویر خود را با دوستتان یا یک عکس دیگر عوض کنید. شما میتوانید در این حالت فیلم یا عکس گرفته و با اضافه کردن استیکر، آن را در شبکههای اجتماعی به اشتراک بگذارید. مورد قابل توجه درباره این اپلیکیشن آن است که برخلاف سایر نرم افزارهای جابجایی چهره، این برنامه آنقدر هم استاتیک نیست و کمی چهرهها حرکت میکنند. چندین افکت سهبعدی و ماسکهای مختلف هم وجود دارند. اگر به دنبال یک برنامه دیپ فیک میگردید، Face Swap Live میتوانید جایگزینی برای Zao محسوب شود.

همانطور که مشاهده کردید در آیندهای نه چندان دور و با گسترش فناوری دیپ فیک، عملا تشخیص بین مرز حقیقت و دروغ غیرممکن خواهد شد. علاوه براین تولید و فراگیر شدن نرمافزارهای تغییر چهره مبتنی بر Deep Fakeنیز هشداری جدی بر نقض حریم خصوصی کاربران هستند. باید منتظر ماند و دید که پیشرفت بی مهابای فناوری تا کجا بر زندگی افراد تاثیر خواهد گذاشت. در این مطلب نگاهی به فناوری جعل عمیق و چند نمونه از کاربرد آن داشتیم و چندین سایت و نرم افزار دیپ فیک را هم معرفی کردیم. نظر شما درباره دیپ فیک چیست؟ چه آیندهای را برای آن پیشبینی میکنید.

نظر کاربران

باید برای پوتین قاتل میساختن

پاسخ ها

کلی قراره به زودی تو ایران کلاهبرداری شه با این روش باید قضات به روز شن و رای به واسطه فایل صوتی یا تصویر ندن اوضاع خطرناکی تو ایران هست چون هشتاد درصد عامه هنوز بیسوادن تو تکنولوژی ای تی

از زلونسکی سوختن خخخخخ

ایران الان تو فکر فیلتر و نابودیشه

چرا برای مسئولین خودمون نساختن هنوز بخندیم

این دیگه خداییش خیلی مسخره و بحران سازه!!!

امان از دست این موجود دو پا!!!!!!!!